Zalew dalekowschodnich klonów komputerów PC (produkowanych na bazie udostępnionej do powszechnego użytku dokumentacji technicznej) „podmył fundamenty" firmy IBM. Każdy, kto mógł, produkował takie komputery, nazywane dla odróżnienia od oryginałów „kompatybilne z IBM PC". Mieliśmy także u nas w Polsce ambitną próbę produkowania takich „kompatybilnych" komputerów – pod nazwą Mazovia. Opowiem o tym, bo chociaż to była boczna gałąź w opisywanej tu historii ewolucji komputerów, to jednak warto o niej wspomnieć.

Komputer PC nieskutecznie spolonizowany

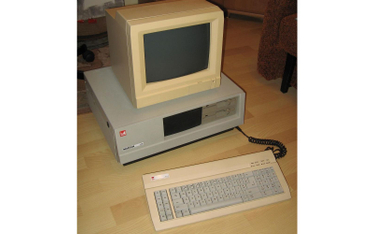

Mazovia została skonstruowana w 1986 r. przez grupę polskich konstruktorów związanych z Instytutem Maszyn Matematycznych w Warszawie, której szefem był mgr inż. Janusz Popko. Zawiązana przez nich spółka Mikrokomputery zaczęła produkować klony IBM PC uwzględniające polskie realia. Owe realia to była przede wszystkim konieczność oparcia konstrukcji komputerów na częściach produkowanych wyłącznie w krajach RWPG (czyli krajach komunistycznych, zależnych od ZSRR). Wynikało to z faktu, że import podzespołów elektronicznych z krajów spoza żelaznej kurtyny był bardzo utrudniony, a czasem wręcz niemożliwy. Niestety, części produkowane w krajach RWPG miały z reguły gorsze parametry niż ich amerykańskie odpowiedniki, dlatego cały komputer miał także gorsze parametry. Nie podobało się to potencjalnym klientom!

Atutem, który miał przekonać polskiego użytkownika do wyboru Mazovii, było umożliwienie mu wygodnego używania polskich znaków. Jak wiadomo, przy wykorzystaniu komputera do pisania i redagowania tekstów używa się specjalnych kodów zamieniających litery tekstu na numery zapamiętywane przez komputer. Zasady tego przypisania numerów do liter ustalono po raz pierwszy w 1963 r. Powstał wtedy standard ASCII (American Standard Code for Information Interchange) objęty amerykańską normą ASA X3.4-1963, który potem wielokrotnie modyfikowano. Kod ASCII był dopasowany tylko do alfabetu angielskiego, w którym oczywiście nie ma znaków charakterystycznych dla języka polskiego: ą, ę, ć itd.

Twórcy Mazovii w swoich komputerach wprowadzili sposób kodowania polskich liter, a także uwzględnili je na klawiaturze i w asortymencie znaków wyświetlanych na ekranie oraz drukowanych na drukarce. Mieli jednak pecha – zanim ich standard zdołał się utrwalić, pojawiły się inne propozycje kodowania polskich znaków. Międzynarodowa instytucja normalizacyjna ISO wydała normę ISO-8859-2, w której sposób kodowania polskich znaków (nazwany Latin-2) został zdefiniowany inaczej niż w Mazovii. Normę ISO przejęła polska norma PN-93 T-42118 i stała się ona obowiązującym prawem. Co więcej, potentat na rynku oprogramowania komputerów osobistych, twórca systemu Windows, firma Microsoft, też zajął się sprawą kodowania polskich (i innych słowiańskich) znaków, wprowadzając stronę kodową Windows 1250. Użytkownicy Mazovii stali się niekompatybilni z resztą świata... Planowano, że komputery Mazovia zaleją Polskę. Wyprodukowano na początek 3000 sztuk – ale bardzo źle się sprzedawały. Cała inicjatywa padła.

IBM przechodzi do kontrataku

Na skutek zalewu komputerów PC wielu klientów IBM, którzy wcześniej wykorzystywali należące do tej firmy komputery klasy mainframe, przeszło na samoobsługę z wykorzystaniem mikrokomputerów kompatybilnych z IBM PC. Zapotrzebowanie na mainframe firmy IBM dramatycznie spadło. To poważnie zagroziło finansom informatycznego giganta. Wrócił on więc do swojego „niechcianego dziecka" i w 1983 r. wypuścił nowy hit rynkowy: IBM PC/XT. Skrót XT pochodził od słowa extended (poszerzony, ulepszony).